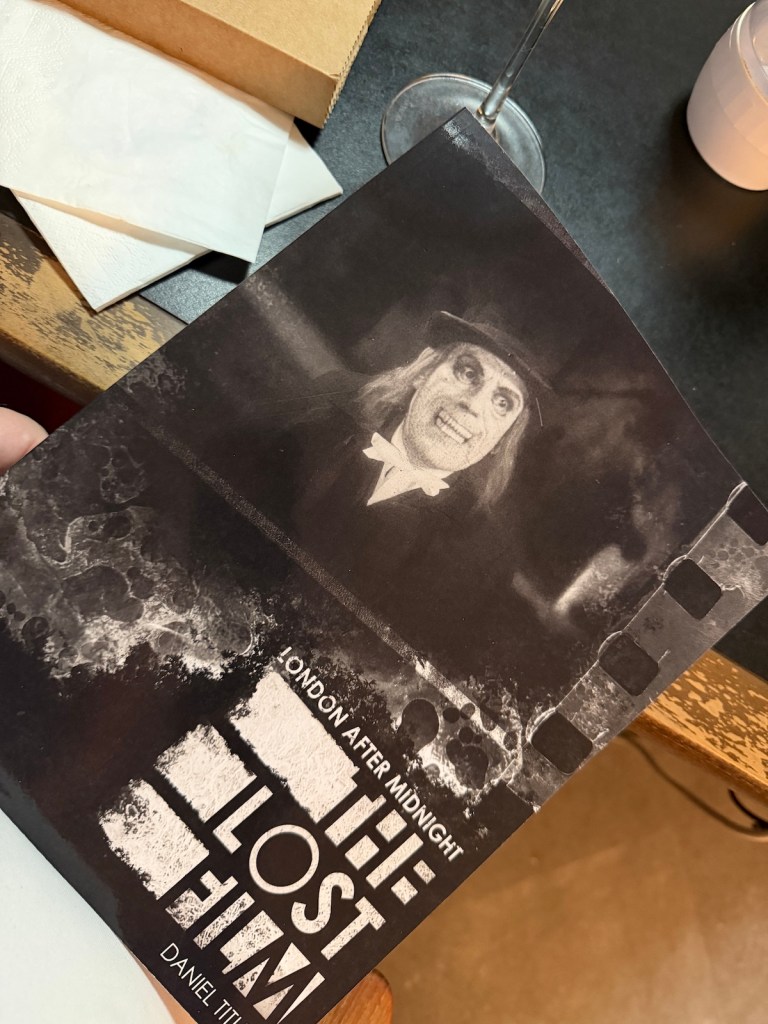

Daniel Titleys Buch London After Midnight – The Lost Film nähert sich einem der berühmtesten verlorenen Filme der Filmgeschichte nicht über Mythen oder Sensationslust, sondern über sorgfältige Rekonstruktion, Quellenarbeit und kritische Einordnung. Statt den verschollenen Stummfilm von 1927 linear nachzuerzählen, versammelt Titley thematisch gegliederte Essays, die gemeinsam ein möglichst vollständiges Bild eines Werks zeichnen, das heute nur noch in Fragmenten existiert – und gerade dadurch zur Legende wurde. Das Buch war wunderbares Weihnachtsgeschenk meiner Frau.

Zu Beginn widmet sich das Buch der Entstehungsgeschichte von London After Midnight. Ausführlich beleuchtet werden Tod Brownings Arbeitsweise, Lon Chaneys berühmte Doppelrolle, die Produktionsbedingungen bei MGM sowie die Einordnung des Films in die Horror- und Mysterylandschaft der 1920er-Jahre. Deutlich wird dabei, dass es sich nicht um einen klassischen Vampirfilm handelte, sondern um ein kriminalistisches Täuschungsspiel, das Horrormotive gezielt einsetzte, um Figuren und Publikum zu manipulieren. Chaneys ikonische Erscheinung mit Zylinder und spitzen Zähnen war demnach keine übernatürliche Figur, sondern Teil eines inszenierten Betrugs innerhalb der Handlung.

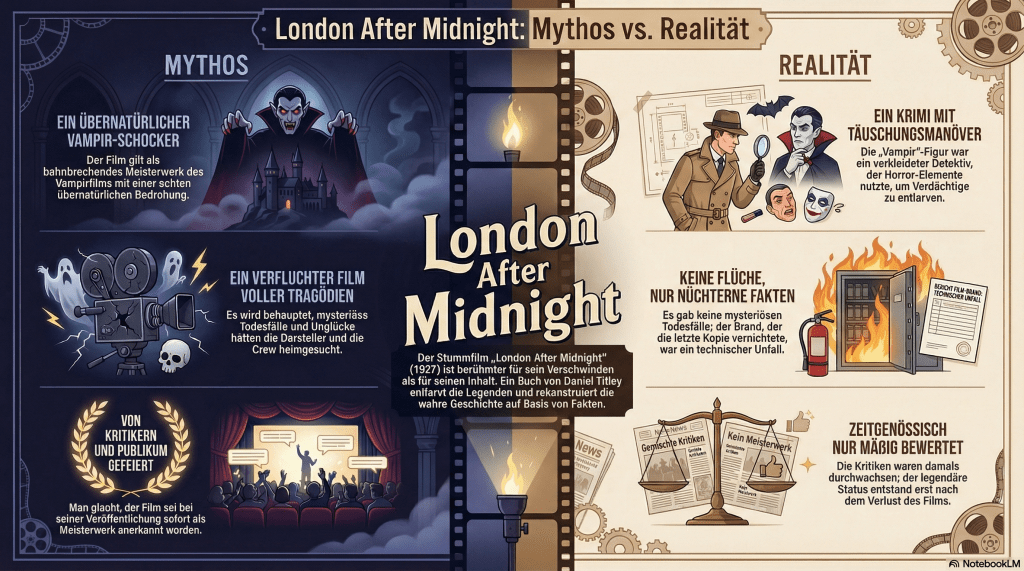

Ein weiterer Schwerpunkt liegt auf der zeitgenössischen Rezeption. Anhand von Kritiken, Pressemeldungen und Werbematerial zeigt Titley, dass der Film bei seinem Erscheinen zwar als unheimlich und ungewöhnlich wahrgenommen wurde, jedoch keineswegs als Meisterwerk galt. Erst sein späteres Verschwinden verlieh ihm den besonderen Status. Die nachträgliche Aufladung als „größter verlorener Horrorfilm“ ist somit weniger Ergebnis seiner damaligen Wirkung als vielmehr ein Produkt der Filmgeschichte im Rückblick.

Zentral für das Buch ist die detaillierte Auseinandersetzung mit dem Verlust des Films. Titley rekonstruiert, wie Kopien nach und nach verschwanden und warum gerade der MGM-Archivbrand von 1965 in Culver City das endgültige Ende bedeutete. Ursache des Feuers war das hochentzündliche Nitrocellulose-Material, das bei mangelhaften Lagerbedingungen leicht zur Selbstentzündung neigte. Der Brand zerstörte Hunderte von Filmen, London After Midnight war nur eines von vielen Opfern – wurde aber erst im Nachhinein zum Symbol aller „lost films“. Titley zeigt nüchtern, dass hier weder ein Fluch noch besondere Fahrlässigkeit im engeren Sinn vorlagen, sondern die damals übliche Geringschätzung alter Stummfilme als Kulturgut.

Einen großen Raum nimmt die Analyse der erhaltenen Fragmente ein. Standfotos, Drehbuchreste, Zensurunterlagen und zeitgenössische Inhaltsangaben werden ausgewertet, um den wahrscheinlichen Ablauf des Films zu rekonstruieren. Diese Rekonstruktion bleibt bewusst fragmentarisch, erlaubt aber erstaunlich präzise Aussagen über Dramaturgie, Figurenkonstellationen und Auflösung. Besonders hervorgehoben wird Chaneys Doppelrolle als Schlüssel zum Thema Identität und Täuschung – ein früher Ansatz psychologischen Horrors, der ohne echte Monster auskam.

Ebenso gründlich widmet sich Titley der Mythenbildung. Hartnäckige Legenden über mysteriöse Todesfälle, geheime Privatkopien oder wahnsinnige Zuschauer werden systematisch überprüft und widerlegt. Weder Lon Chaneys früher Tod noch Tod Brownings Biografie noch angebliche Vorführungsdramen halten einer quellenkritischen Prüfung stand. Auch die Frage nach dem „letzten Zuschauer“ des Films beantwortet das Buch nüchtern: Es gibt keinen belegten letzten Zeugen. Am wahrscheinlichsten ist, dass der Film zuletzt routinemäßig von anonymen MGM-Archivmitarbeitern gesehen wurde – ohne jedes Bewusstsein für seine spätere Bedeutung.

Abschließend weitet das Buch den Blick auf die Bedeutung verlorener Filme insgesamt. London After Midnight dient als exemplarischer Fall dafür, wie fragmentarisch Filmgeschichte überliefert ist und wie Forschung, Archivarbeit und Imagination zusammenwirken müssen, um kulturelles Erbe zumindest gedanklich zu bewahren. Titleys Ansatz ist dabei vorbildlich: transparent, kritisch und frei von Spekulation.

In der Summe liefert London After Midnight – The Lost Film kein endgültiges Bild des Films – und will es auch nicht. Stattdessen entsteht eine dichte Annäherung an ein Werk, das weniger durch das, was man sehen kann, berühmt wurde, als durch das, was fehlt. Das eigentliche Mysterium ist nicht der Film selbst, sondern die Legende, die aus seinem Verschwinden entstanden ist.

Warum ist das Buch so wichtig für uns Filmfreunde?

- Entzauberung des Vampir-Mythos

Ein zentrales Highlight ist die klare Erkenntnis, dass London After Midnight kein klassischer Vampirfilm war. Titley zeigt überzeugend, dass es sich um ein kriminalistisches Täuschungsspiel handelte, in dem Horrorästhetik bewusst eingesetzt wurde, um Figuren (und Publikum) zu manipulieren. - Neue Rekonstruktion des Filmablaufs

Anhand von Standfotos, Zensurprotokollen, Drehbuchfragmenten und Pressematerial rekonstruiert Titley den wahrscheinlichen Szenenablauf des Films erstaunlich detailliert – inklusive Rollenverteilungen, Spannungsbögen und Auflösung. - Seltene und teils unveröffentlichte Bildquellen

Das Buch enthält außergewöhnlich viel seltenes Bildmaterial, darunter alternative Standfotos und Varianten bekannter Motive. Diese zeigen, wie stark Chaneys Maskenarbeit mit Licht, Pose und Kameraeffekt spielte. - Kritische Demontage von Legenden

Titley räumt systematisch mit jahrzehntelangen Gerüchten auf: angebliche Privatkopien, geheime Vorführungen oder mysteriöse Todesfälle im Umfeld des Films werden quellenkritisch widerlegt. - Neubewertung der zeitgenössischen Kritik

Ein überraschender Punkt: Zeitgenössische Rezensionen waren durchwachsen bis nüchtern. Erst der Verlust des Films machte ihn zur Ikone – ein starkes Beispiel dafür, wie Filmgeschichte rückwirkend verklärt wird. - Lon Chaneys Doppelrolle als Schlüsselidee

Besonders hervorgehoben wird Chaneys Spiel mit Identität: Seine Doppelrolle verstärkt das Thema der Täuschung und macht den Film zu einem frühen Beispiel für psychologischen Horror statt Monsterkino. - Bedeutung für die Lost-Film-Forschung

Das Buch gilt als Musterbeispiel dafür, wie man einen verlorenen Film wissenschaftlich behandelt: nicht spekulativ, sondern fragmentarisch, kritisch und transparent. - Warum gerade dieser Film zur Legende wurde

Titley zeigt, dass es weniger der Film selbst als vielmehr das ikonische Einzelbild (Zylinder, spitze Zähne, starre Augen) war, das sich ins kollektive Gedächtnis eingebrannt hat.

Das größte Highlight des Buches ist seine Haltung: Es versucht nicht, London After Midnight künstlich zum Meisterwerk zu erklären, sondern macht verständlich, warum ein verlorener, mittelmäßig rezipierter Film zum berühmtesten Phantom der Filmgeschichte werden konnte.

Die angeblichen „mysteriösen Todesfälle“ im Umfeld von London After Midnight gehören zu den hartnäckigsten Legenden – und genau diese nimmt Daniel Titley im Buch sehr gründlich auseinander. Wichtig vorweg: Keiner dieser Fälle hält einer seriösen historischen Prüfung stand.

Die wichtigsten behaupteten Mysterien – und was wirklich dahintersteckt habe ich mal aufgeführt und reflektiert.

- Lon Chaneys früher Tod (1930)

Oft wird behauptet, Chaney sei „kurz nach dem Film“ unter mysteriösen Umständen gestorben oder habe sich für die Rolle gesundheitlich ruiniert.

Falsch: Chaney starb drei Jahre später an den Folgen von Kehlkopfkrebs, begünstigt durch jahrzehntelanges Rauchen und frühere gesundheitliche Probleme. Es gibt keinen Zusammenhang mit London After Midnight. Titley zeigt, dass diese Erzählung erst nach dem Verlust des Films entstand. - Tod Brownings angebliche „dunkle Phase“

Manche Artikel suggerieren, der Regisseur sei nach dem Film psychisch abgestürzt oder vom Stoff „verfolgt“ worden.

Falsch: Browning hatte bereits lange vor dem Film Alkoholprobleme und ein schwieriges Privatleben. Seine Karriere verlief weiter erfolgreich (u. a. Dracula, 1931). Die Verbindung zum Film ist nachträgliche Dramatisierung. - Unbenannte Todesfälle im Cast oder Umfeld

Es kursieren immer wieder vage Behauptungen, mehrere Beteiligte seien „unter seltsamen Umständen“ gestorben.

Falsch: Titley überprüft Cast- und Crewlisten systematisch. Die Todesfälle, die sich nachweisen lassen, waren alters- oder krankheitsbedingt und lagen teils Jahrzehnte später. Keine Häufung, keine Auffälligkeiten. - Der MGM-Archivbrand als „Fluch“

Das Feuer von 1965, bei dem der letzte bekannte Print zerstört wurde, wird oft als Teil einer „unheilvollen Geschichte“ erzählt.

Falsch: Archivbrände waren bei Nitrofilm leider häufig. London After Midnight war eines von Hunderten verlorenen Werken. Die Sonderstellung entstand erst im Nachhinein. - Mord- und Wahnsinnsgerüchte rund um Vorführungen

In Fanmagazinen und später im Internet tauchten Geschichten auf, Zuschauer seien nach Sichtungen psychisch zusammengebrochen oder hätten Verbrechen begangen.

Falsch: Keine einzige Quelle aus der Zeit belegt solche Vorfälle. Titley weist nach, dass diese Geschichten aus späteren Horror-Fanzines stammen.

Das eigentliche „Mysterium“ ist nicht ein realer Todesfall, sondern die Mythenbildung selbst. Je weniger vom Film existierte, desto stärker wurde er mit Fluch-Narrativen,okkulten Untertönen und Todes- und Wahnsinnsgeschichten aufgeladen.

Aber: Es gab keine mysteriösen Todesfälle im Umfeld von London After Midnight.

Was es gab, war ein verlorener Film, ein ikonisches Bild – und Jahrzehnte später ein perfekter Nährboden für Legenden.

Ich bin sehr dankbar für dieses Buch und wünsche mir mehr davon. Und ich bin erstaunt, welche Wirkung der Film heute noch hat. Als ich am 1. April einen Aprilscherz machte, explodierte das Netz. Ich erfand eine Geschichte, dass eine komplette Kopie von London After Midnight aufgetaucht sei. Aber ich hatte gelogen. Was wäre es für eine schöne Geschichte geworden!