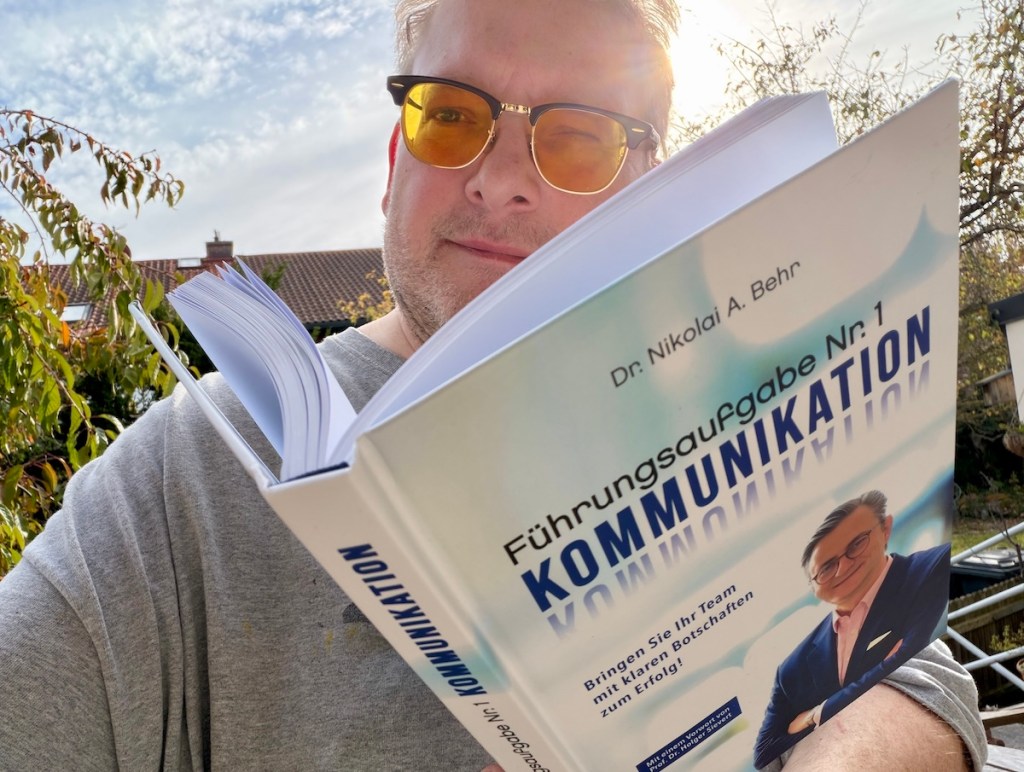

Gleich vorweg: Ich bin mit dem Autoren seit langem bekannt und schätze seine Veranstaltungen und sein Fachwissen rund um das Thema Führung. Nun hat Nikolai A. Behr mir sein neues Buch empfohlen, dass ich im Hinblick als jahrelange Führungskraft als Textchef und Chefredakteur bei verschiedenen Verlagen gelesen habe. Und ich wurde bei der Lektüre wieder bestätigt, dass Behr einfach den Bogen raus hat.

Das 2025 im brain script Verlag erschienene Buch „Führungsaufgabe Nr. 1: Kommunikation“ von Dr. Nikolai A. Behr ist ein praxisorientiertes und zugleich tiefgründiges Werk über eine der zentralen, oft unterschätzten Anforderungen moderner Führung: die Fähigkeit, wirkungsvoll zu kommunizieren. Behr, selbst erfahrener Medientrainer und Kommunikationsberater für Topmanager, verbindet in seinem 149 Seiten starken Buch theoretische Fundierung mit unmittelbarer Anwendbarkeit – ein Leitfaden, der die Kunst des Führens nicht über Kennzahlen, sondern über Haltung, Sprache und Resonanz neu denkt. Immer wieder holte ich mir in der Vergangenheit Inspiration für meine Arbeit aus seinen Shorts in sozialen Netzen. Jetzt kann ich (endlich) dazu auch sein Buch nutzen.

Im Aufbau zeigt sich die klare Struktur des Werks: Sechs Hauptkapitel führen die Leserinnen und Leser von der Einordnung klassischer Managementaufgaben über die zentrale Rolle der Kommunikation bis hin zu konkreten Werkzeugen und Modellen. Besonders hervorzuheben ist der sogenannte G.A.M.E.-Code, ein von Behr eigens entwickeltes Konzept zur systematischen Verbesserung der Kommunikationsqualität. Er steht exemplarisch für den Ansatz des Buches, Kommunikationsprozesse greifbar und trainierbar zu machen. In weiteren Kapiteln behandelt Behr Themenfelder wie empathische Gesprächsführung, aktives Zuhören, rhetorische Klarheit, digitale Medienkompetenz sowie den Umgang mit interkulturellen Differenzen im Führungsalltag.

Bemerkenswert ist die Sprache, die Behr wählt: präzise, unpathetisch, aber von spürbarer Leidenschaft für sein Thema getragen. Er vermeidet die Floskelhaftigkeit vieler Leadership-Ratgeber und arbeitet stattdessen mit Fallbeispielen aus realen Unternehmen, wissenschaftlich fundierten Argumenten und nachvollziehbaren Kommunikationsstrategien. In Zitaten wie „Wer Kommunikation nur als Soft Skill betrachtet, unterschätzt ihren Hebel für echte Transformation“ wird seine Kernbotschaft deutlich – Führung ist kein Status, sondern Beziehungsarbeit, und Sprache das wichtigste Werkzeug dieser Beziehung.

Das Buch richtet sich ausdrücklich an Führungskräfte aller Ebenen – vom Teamleiter bis zur Geschäftsführung – und eignet sich auch für Coaches und Trainer, die Kommunikationsarbeit vertiefen möchten. Bei der Lektüre habe ich festgestellt, was ich in meiner Führungspraxis so manches Mal falsch gemacht habe, indem ich Mitarbeitern meine Ideen nicht immer vermitteln konnte. Hätte ich dieses Buch bloß früher gelesen.

Seine Stärke liegt dabei in der Balance zwischen Reflexion und praktischer Nutzbarkeit: Behr bietet nicht nur Anregungen, sondern konkrete Übungen und Denkroutinen, die sich in den Führungsalltag integrieren lassen. Gerade in einer Zeit hybrider Arbeitsmodelle und digitaler Distanz wirkt seine Forderung nach Empathie und Präsenz im Dialog dringlicher denn je. Ich hatte zu meiner Zeit noch alle Mitarbeiter im Büro am Ort sitzen, daher empfand ich die Ausführungen zur digitalen Führung besonders spannend.

„Führungsaufgabe Nr. 1: Kommunikation“ ist mehr als ein weiterer Managementratgeber – es ist für mich ein Plädoyer für sprachbewusste, menschlich orientierte Führung. Nikolai Behr gelingt es, Kommunikation als strategisches Führungsinstrument zu begreifen und zugleich deren ethische Dimension offenzulegen: dass gute Führung immer mit ehrlichem Zuhören und respektvollem Sprechen beginnt. Für alle, die in modernen Organisationen gestalten, motivieren und überzeugen wollen, sollte dieses Buch eine inspirierende Pflichtlektüre sein.

Die Hauptthesen

Die Hauptthesen von Nikolai A. Behrs Buch „Führungsaufgabe Nr. 1: Kommunikation“ (brain script Verlag, 2025) lassen sich in fünf Kernaussagen zusammenfassen. Sie beschreiben Kommunikation als den entscheidenden Hebel moderner Führung und begründen, warum sie weit mehr ist als ein „Soft Skill“.

Erstens: Kommunikation ist die wichtigste Führungsaufgabe. Behr argumentiert, dass alle wesentlichen Managementprozesse – Motivation, Orientierung, Strategieumsetzung – durch Kommunikation vermittelt werden. Ohne klare, konsistente Kommunikation scheitert jede Führung, unabhängig von Fachkompetenz oder Hierarchie.

Zweitens: Empathie und Klarheit sind die Leitwerte wirksamer Führung. Gute Führung beginnt mit aktivem Zuhören und setzt emotionale Intelligenz voraus. Nur wer die Perspektive anderer nachvollzieht, kann Vertrauen und Bindung aufbauen – zentrale Faktoren für Mitarbeitermotivation und Zusammenarbeit.

Drittens: Kommunikation wirkt auf allen Ebenen – verbal, nonverbal und digital. Behr betont, dass Führungskräfte ihre Wirkung in Präsentationen, Meetings, E-Mails oder Videokonferenzen bewusst gestalten müssen. Zugleich warnt er vor der Illusion, Kommunikation sei bloß Rhetorik; sie ist immer auch Haltung und gelebte Authentizität.

Viertens: Kommunikation entscheidet über den Erfolg von Veränderungsprozessen. Besonders in Krisen, Transformationen und hybriden Arbeitsumgebungen ist Verständlichkeit das wichtigste Führungsinstrument. Behr fordert eine proaktive, wertschätzende Sprache, die Orientierung gibt und Ängste abbaut.

Fünftens: Kommunikation ist trainierbar. Mit dem von Behr entwickelten G.A.M.E.-Code bietet das Buch ein praxisnahes System, um Kommunikationsmuster zu analysieren, Feedbackprozesse zu verbessern und Botschaften wirksamer zu gestalten. Der Ansatz steht für die These, dass kommunikative Exzellenz kein Zufall, sondern Ergebnis bewusster Selbstreflexion und Übung ist.