Im vergangenen Jahr setzte die Textilkette Mango auf ein KI-Model für seine Sommerkollektion. Nun geht das Möbelhaus XXXLutz einen Schritt weiter und präsentiert Lucy.

Lucy Heimfeld oder – Homefield, wie sie sich online nennt – ist ein ebenso positiver wie achtsamer KI-Charakter, der sich den Themen Einrichtung, Wohnen, Dekoration und Lifestyle widmet. Lucy ist freundlich zu sich und ihrer Umwelt, liebt den Austausch mit anderen, aber auch die ruhigen Momente der Reflexion, so heißt es bei XXXLutz. Ihr Stil und ihre Persönlichkeit seien geprägt von einer Balance zwischen Aktivität und Ruhe – ebenso wie ihr Tagesablauf. In ihrer hochwertig sanierten Altbauwohnung inmitten einer pulsierenden Stadt wie Hamburg lebt sie ihre Leidenschaft für stilvolle und harmonische Räume als Content Creator aus. Mit Ende Zwanzig hat sie bereits reichlich Erfahrung als Einrichtungsberaterin und ist fest entschlossen, ihre Community daran teilhaben zu lassen und eine „echte“ Hilfe zu sein, berichtet XXXLutz in einer Mitteilung. Als Influencerin tummelt sich Lucy erst einmal auf Instagram (@lucy_homefield).Es soll aber noch mehr kommen.

Nun ich hatte keine Probleme in der Vergangenheit mich von Animation- oder Zeichentrickfiguren unterhalten zu lassen, warum nicht heute auch von KI-Wesen. Hat sich da wirklich etwas geändert?

Von Menschen für Menschen und doch KI-generiert – ein Widerspruch? „Ganz im Gegenteil“, betont Konrad Nill, CMO bei XXXLutz Deutschland: „Lucy bringt das Wissen unserer Einrichtungsberater und -Beraterinnen mit: immer am Puls internationaler Trends, begeisternd sowie inspirierend und als KI-Person ist sie ,always on‘.“ Lucy ist räumlich und zeitlich flexibel einsetzbar: jederzeit an jedem Ort, gleichzeitig auf den unterschiedlichen Kanälen und auch kurzfristig einsatzbereit. Wenn Lucy als Chatbot umfänglich zum Einsatz kommt, kann sie/es wirklich eine Bereicherung sein und mehr als nur ein Marketinggag.

„Was uns wichtig ist und worauf wir Wert legen: Unsere Kampagne ist weiterhin von echten Menschen getragen. Der hochgezahlte Markenträger Matthias Schweighöfer als Markenbotschafter kann aber logischerweise nicht rund um die Uhr Kundenanfragen beantworten oder mehrmals pro Woche virtuell in seine Wohnung einladen, um angesagte Trends zu präsentieren.“, weiß Nill: „Für diese Aufgaben ist seine digitale Kollegin wie geschaffen.“

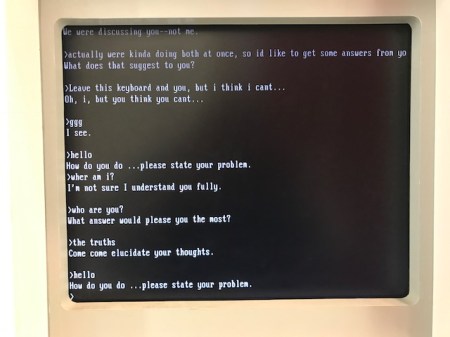

Spätestens beim Einsatz als Chatbot liegen die Vorteile auf der Hand. KI-Tools, in diesem Fall Large Language Modelle, sind wichtiger Baustein, um künftig Kundenanfragen besser zu verstehen und passgenauere Antworten ausspielen zu können. Ihnen dabei auch einen Namen und ein Gesicht zu geben, ist nicht nur aus Marketingsicht sinnvoll. Menschen unterhalten sich einfach lieber mit einem Charakter, als mit einer Maschine – und bei XXXLutz ist das (auch) „Lucy Homefield“. Und dennoch: Lucy ist eine Maschine und muss trainiert werden. Auf Standardantworten kann ich als Kunde verzichten auch wenn das Gesicht noch so hübsch und freundliche ist.

KI fester Bestandteil bei XXXLutz

KI-Anwendungen werden weiter eine stark wachsende Rolle beim Branchenprimus der Möbelbranche spielen. Und das nicht nur in der Kommunikation. „Mit Lucy ist ein weiterer Schritt in eine digitale Zukunft gemacht,“ freut sich Konrad Nill. XXXLutz launchte bereits vor drei Jahren Deutschlands größtes virtuelles Küchenstudio. „Wer Trends im Einrichten setzen möchte, muss auch Trends in der Vermarktung setzen“, sagt Nill. Mal sehen, ob Kunden sich mit Lucy anfreunden können. Mir als Münchner kommt eine Hamburger Einrichtungsberaterin skeptisch vor, aber ich lasse mich gerne überzeugen. Ich gebe der KI eine Chance, egal ob sie Lucy oder Elvira heißt.