Seit dem 12. Dezember 2025 steht die Live-Übersetzung mit Apple AirPods nun auch Nutzerinnen und Nutzern in Europa offiziell zur Verfügung. Ich hab das Update gleich geladen und ausprobiert. Der Hammer!

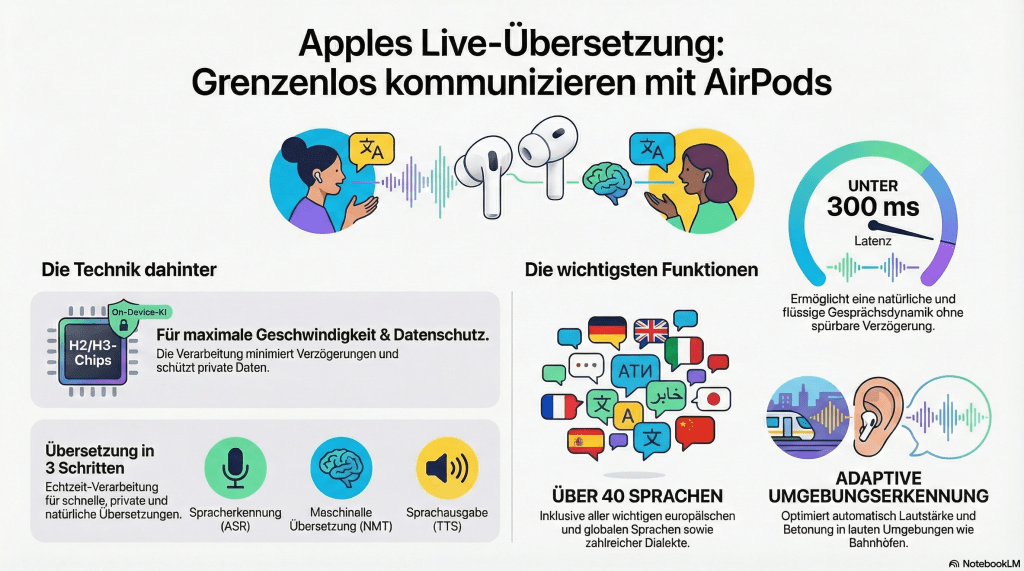

Die Funktion, die zuvor in den USA getestet wurde, kombiniert fortschrittliche On-Device-Spracherkennung mit KI-gestützter Übersetzung in Echtzeit. Technisch basiert das System auf der Neural Engine der Apple H2- und H3-Chips, die Sprachsignale lokal verarbeiten und so Verzögerungen minimieren. Eine stabile Internetverbindung wird nur noch zur Synchronisierung komplexer Sprachmodelle benötigt, wodurch der Datenschutz auf hohem Niveau bleibt.

Apple analysiert das System Sprache in mehreren Verarbeitungsschritten:

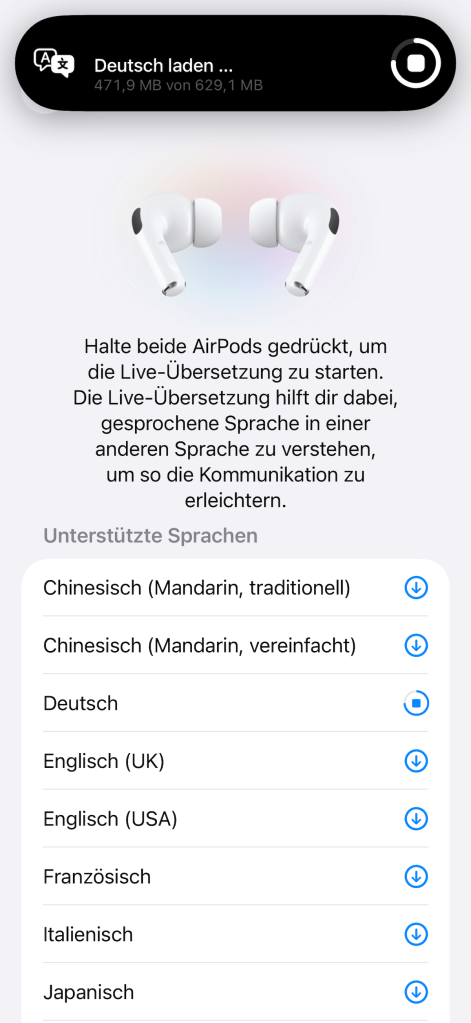

1. Spracherkennung (ASR) – Umwandlung des Audiosignals in Text mittels neuronaler Netze.

2. Maschinelle Übersetzung (NMT) – Übersetzung des erkannten Textes über ein kontextsensitives Transformer-Modell.

3. Sprachausgabe (TTS) – Synthese der übersetzten Sprache in Echtzeit, abgestimmt auf die Stimmeinstellungen des Nutzers.

Apple setzt dabei auf On-Device Processing, um Latenzzeiten zu minimieren und Datenschutzstandards einzuhalten.

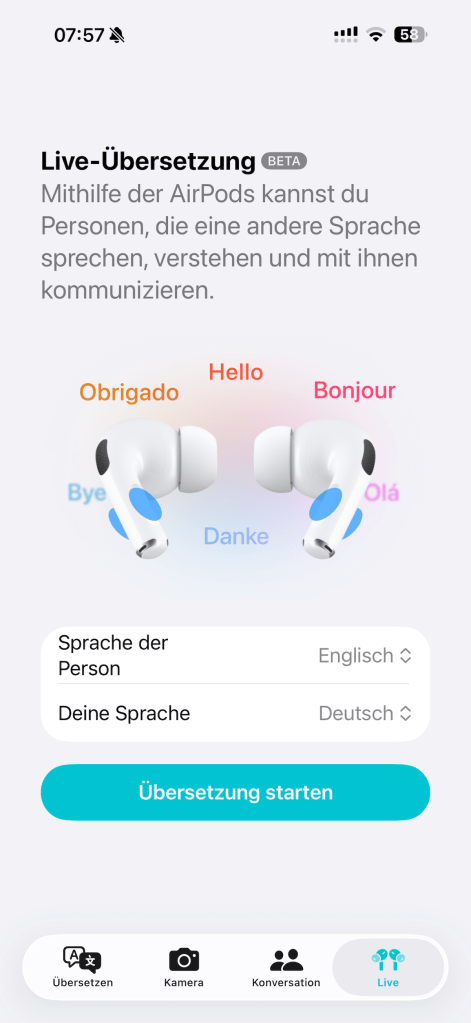

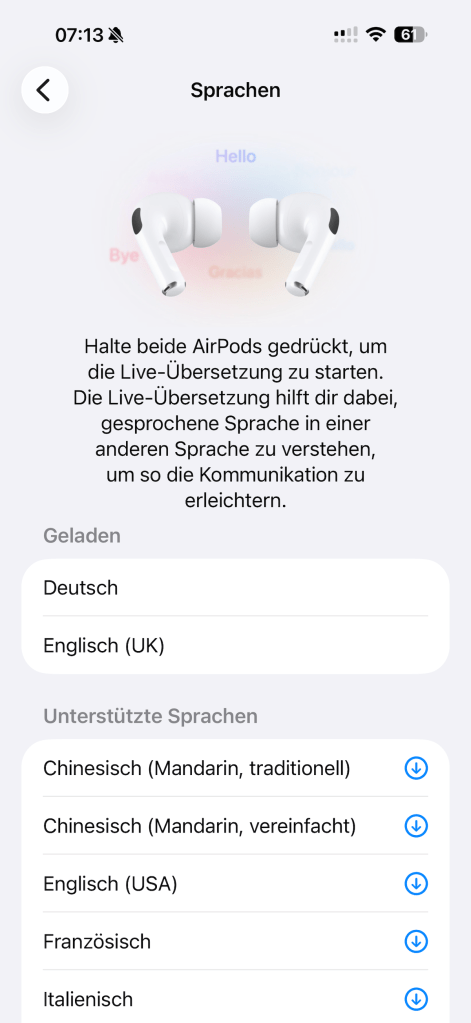

Im praktischen Einsatz aktivieren Nutzer die Übersetzung über Siri oder direkt in der Systemsteuerung der AirPods. Nach Auswahl der gewünschten Sprachen werden gesprochene Sätze in Echtzeit erkannt, übersetzt und über die Kopfhörer ausgegeben. In Kombination mit iPhone oder Vision Pro ermöglicht das System auch eine visuelle Transkription, die auf dem Display oder im Sichtfeld eingeblendet wird. Besonders bemerkenswert ist die niedrige Latenzzeit: Apple spricht von weniger als 300 Millisekunden zwischen gesprochener Eingabe und der übersetzten Wiedergabe, was eine natürliche Gesprächsdynamik erlaubt.

Die Übersetzung wird in über 40 Sprachen und Dialekten unterstützt, darunter Deutsch, Französisch, Italienisch, Spanisch, Japanisch und Mandarin. Neu ist die adaptive Umgebungserkennung: Durch die Analyse von Hintergrundgeräuschen und Gesprächssituationen optimieren die AirPods Lautstärke, Betonung und Sprachebene der Übersetzung automatisch. Das macht die Funktion auch in lauten Umgebungen wie Bahnhöfen oder Konferenzsälen zuverlässig einsetzbar.

Mit dieser europäischen Einführung setzt Apple einen weiteren Schritt in Richtung kontextbewusster, KI-gestützter Kommunikation. Die Kombination aus mobiler Rechenleistung, Spracherkennung und maschinellem Lernen in Echtzeit hebt die AirPods damit über ihre ursprüngliche Audio-Funktion hinaus – hin zu intelligenten Schnittstellen zwischen Menschen unterschiedlicher Sprachen. Und als Tourist kann ich verstehen, was der französische Kellner mir an den Kopf wirft, wenn mein Schulfranzösisch versagt.